Bu yazımda bazı haberler verecek, yapay zekadan söz edecek ve yine kendimce bağlantılar/sonuçlar çıkarmaya çalışacağım.

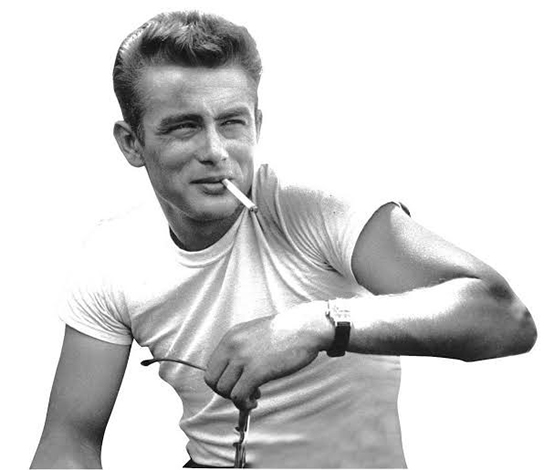

Birincisi, James Dean ile ilgili. Onu Rebel Without a Case (Asi Gençlik – 1955) ve East of Eden (Cennet Yolu – 1955) filmleriyle tanıdı dünya. 1931’de doğdu, 1955’te bir otomobil kazasında öldü.

Öldü mü? Sinema endüstrisi ve yapay zeka şirketleri, bunun böyle olmamasına karar verdi.

BBC’nin haberinde, şöyle deniyor:

“Dean, ölümünden neredeyse 70 yıl sonra, Back to Eden adlı yeni bir filmde başrolde olacak.

Aktörün ‘deepfake‘ videolarında kullanılana benzer bir yapay zeka (AI) teknolojisiyle oluşturulan klonu ekranda hareket edecek, konuşacak ve diğer oyuncularla etkileşime girecek.”

Özeti şudur: Yapay zeka, James Dean’in görüntü kayıtlarıyla beslenmiş, onu klonlamış, sonra da yeni bir filmde oynatmaya başlamıştır.

Bu teknolojinin, “Bilgisayar Tabanlı İmgeleme”nin (CGI – Computer Generated Imagery) en ileri safhasını temsil ettiği belirtilmektedir.

Diğer bir haber, yukarıdakiyle bağlantılıdır.

2 Mayıs 2023’te, Amerikan Senaristler Birliği’ne (WGA) üye yaklaşık 11 bin 500 senarist, greve gitti.

14 Temmuz’da, yaklaşık 65 bin oyuncuyu temsil eden Televizyon Yapımcıları Birliği (SAG) ve Amerikan Televizyon, Radyo Sanatçıları (AFTRA) iş bıraktı.

Yapay zekanın, işlerini ellerinden alacağını görmüşlerdi.

(Resme tıklayarak, YouTube’daki haber videosuna erişebilirsiniz.)

Hollywood, oyuncuların yapay zeka replikalarının haklarını istemişti.

Bir haber sitesinde, Black Mirror’un son sezonundaki “Joan is Awful” bölümü hatırlatılarak, bu isteğin ne anlama geldiği bildirilmektedir.

“Yani dijital ortamda yaratılan bir içerikte, oyuncuların dijital replikasıyla, tanıdığımız bir sanatçının sesi, yüzü, mimikleri, kısacası o sanatçıyı kendisi yapan her unsuru kullanılarak film çekilebilecek.”

Dublör koordinatörü Freddy Bouciegues, Fransız haber ajansı AFP’ye konuştu.

Haberde, birçok film şirketinin dublörlerden üç boyutlu tarama programları aracılığıyla görüntülerinin dijital ortama aktarılmasını talep ettiğine fakat görüntülerin ne zaman ve ne şekilde kullanılacağına dair bilgi vermediğine dikkat çekildi.

Yapay zekadaki ilerlemelerle birlikte, bu görüntülerin dublörlerin “dijital replikalarına” dönüştürülüp farklı sahnelerde defalarca kullanılabileceğine işaret edildi.

Aynı sorun, seslendirme sanatçıları için de söz konusudur. Stoklanan ses kayıtları ve yapay zeka, kişinin kendi iradesinden bağımsız olarak “konuşturulabilmesine” imkan tanımaktadır.

Geliyoruz Scarlett Johansson’a.

Bir haber sitesinde, aşağıdaki bilgiler verilmiştir:

“Hollywood yıldızı Scarlett Johansson, izni olmadan adını ve sesini kullanan bir yapay zeka uygulamasına dava açtı.

Johansson’un sesi 22 saniyelik bir reklamda ‘Lisa AI: 90s Yearbook & Avatar’ adlı yapay zeka ile taklit edildi. Reklamda Johansson’un taklit sesi ile ‘Bu sadece avatarlarla sınırlı değil. Metinlerle görsel ve hatta yapay zeka videolarınızı oluşturabilirsiniz. Bence bunu kaçırmamalısınız’ deniyor.”

Yukarıda da belirttim, sadece görüntü değil, ses de risk altındadır.

Black Mirror ve “Joan is Awful”a gelince.

Dizinin ilgili bölümüne ilişkin IMDB sayfasında “konu” başlığında aşağıdaki özet yer alıyor:

“Joan lives a fairly average existence and is shocked to discover that her everyday life has been made into a TV show. Every embarrassing detail is depicted within hours of it occurring. As a result of these revelations she loses her job, her boyfriend and her privacy.”

Bunu, Google Translate şöyle çeviriyor:

“Joan oldukça ortalama bir yaşam sürüyor ve günlük yaşamının, bir televizyon programına dönüştürüldüğünü öğrendiğinde şok oluyor. Her utanç verici ayrıntı, meydana geldikten birkaç saat sonra tasvir ediliyor. Bu açıklamaların sonucunda işini, erkek arkadaşını ve mahremiyetini kaybeder.”

Peki SORA nedir?

Open AI şirketinin yeni yapay zeka modelidir. Anadolu Ajansı’nın haber sitesinde “ChatGPT’yi geliştiren yapay zeka şirketi OpenAI, metin komutlarıyla gerçekçi ve yaratıcı sahneler oluşturabilen yapay zeka modeli Sora’yı tanıttı.” denilmektedir. Sitede, teknoloji muhabiri Kadir Günyol’la yapılan bir röportajın ses kaydı mevcuttur.

Kadir Günyol’un söylediklerinde öne çıkanlar şunlardır: Google’ın tanıttığı Gemini ve bir diğer yapay zeka uygulaması olan MidJourney’deki eksikler (Japonca’da “gökyüzü” anlamına gelen) SORA’da giderilmiş durumdadır. SORA ile, çok daha gerçekçi sahneler oluşturulabilmektedir. Kadir Günyol, SORA’nın ürettiği “görüntüleri gerçekle ayırdetmenin çok zor” olduğunu belirtmekte ve bu durumun kendisine, manipülasyon yapmaya yönelik bir araç olma ihtimalinden ötürü “çok tehlikeli” geldiğini belirtmektedir.

Podcast’te, ElevenLabs’den de söz edilmektedir. Konuşmacı, ElevenLabs sayesinde “eğer siz, sesinizi de oraya klonlarsanız, görüntünüzü de başka bir yerde oluşturursanız, sanki hiç olmayan bir ortamda siz konuşuyormuş gibi videolar ortaya çıkma ihtimali doğdu”ğunu söylemektedir.

En önemlisi, bu araçlar yüzünden “demokrasilerin tehlike altında olduğu” sonucunu çıkarmasıdır. Kendisine göre, buna yol açan, sosyal medyada bu videoları izledikten sonra gerçekmiş gibi kabul edip yolumuza devam etmemizdir.

SORA ile oluşturulan videoların kullanıldığı bir YouTube videosunun bağlantısını aşağıda veriyorum. Görüntülerin gerçekliği şaşırtıcı boyuttadır. (Resme tıklayarak YouTube’a geçebilirsiniz).

SORA’ya ilişkin ayrıntılı teknik bilgiler veren bir yazıyı, buraya tıklayarak okuyabilirsiniz.

Yukarıda ElevenLabs’den de söz edildi. ElevenLabs hakkında, Wikipedia’da, aşağıdaki bilgiler veriliyor (Google Translate çevirisiyle):

“ElevenLabs, derin öğrenmeyi kullanarak doğal ses veren konuşma sentezi yazılımı geliştirmede uzmanlaşmış bir yazılım şirketidir.”

“ElevenLabs öncelikle, vokal duygu ve tonlamayı sentezleyerek gerçekçi konuşmalar üretebilen, tarayıcı tabanlı, yapay zeka destekli metinden konuşmaya yazılımı Speech Synthesis ile tanınıyor. Şirket, modellerinin metindeki bağlamı yorumlayacak ve tonlamayı ve tempoyu buna göre ayarlayacak şekilde eğitildiğini belirtiyor. Metnin bağlamsal yönlerini analiz etmek için gelişmiş algoritmalar kullanarak öfke, üzüntü, mutluluk veya alarm gibi duyguları tespit etmeyi amaçlayarak sistemin kullanıcının duygularını anlamasını sağlayarak daha gerçekçi ve insana benzer bir çekim elde edilmesini sağlar. Startup bu teknolojinin patentini alma sürecinde. Beta sitesinde kullanıcılar, varsayılan seslerden oluşan bir seçkiden metin gönderebilir ve ses dosyaları oluşturabilir. Ödeme yapan kullanıcılara, şirketin ses klonlama aracını kullanarak yeni ses stilleri oluşturmak için özel ses örnekleri yükleme olanağı veriliyor.”

ElevenLabs’in Beta sürümünü, ücretsiz olarak, hazır kaydedilmiş kişi/ses imkanıyla, buraya tıklayarak deneyebilirsiniz.

En son, bütün bunların şemsiye kavramı olabilecek “deepfake”e geliyoruz. Türkçe Wikipedia sayfasında aşağıdaki bilgiler yer alıyor tanım ve kullanımla ilgili olarak:

“Deepfake, mevcut bir görüntü veya videoda yer alan bir kişinin, yapay sinir ağları kullanarak bir başka kişinin görüntüsü ile değiştirildiği bir medya türüdür. Sıklıkla, otomatik kodlayıcılar ve üretken çekişmeli ağlar (GAN’lar) olarak bilinen makine öğrenme tekniklerini kullanarak mevcut medyanın kaynak medya üzerinde birleştirilmesi ve üst üste konması ile üretilirler. Deepfake, ‘deep learning’ (derin öğrenme) ve ‘fake’ (sahte) kelimelerinden türetilmiş bir birleşik kelimedir.

Deepfake, ünlülerin sahte pornografik videolarında, intikam pornosunda, siyasi liderlerin konuşmalarında, sahte haberlerde, aldatmacalarda ve finansal sahtekarlıklarda kullanıldığı için yaygın ilgi görmüştür.”

Sitenin İngilizce sayfasında, şimdiye kadar yapılmış önemli deepfake videoları ile ilgili bilgiler de mevcuttur.

Bunlardan bir örnek verecek olursak, Mayıs 2023’te, Başkan Yardımcısı Kamala Harris’in sözlerini geveleyerek söylediği ve bugün, yarın ve dün hakkında saçma sapan konuştuğu iddia edilen deepfake bir video sosyal medyada viral olmuştu. (Kaynak: Wikipedia)

Johann Hari, “Çalınan Dikkat” kitabında, insanlığın görüntülere artan bağımlılığını resmediyordu. Oğluyla birlikte Elvis Presley’in Malikanesi “Graceland”e gitmişlerdi.

“Graceland’in kapılarına vardığınızda size etrafı göstermekle görevli biri olmuyor ortalıkta. Elinize bir iPad veriliyor, ufak kulaklıklar takıyorsunuz ve ne yapacağınızı iPad söylüyor – sola dön, sağa dön, düz git. İçine girdiğiniz her odada iPad unutulmuş bir oyuncunun sesiyle size o oda hakkında bilgi verirken, ekranda da odanın fotoğrafı beliriyor. Biz de Graceland’i kendi başımıza, iPad’e bakarak gezdik. Etrafımız Kanadalılarla, Korelilerle, Birleşmiş Milletler’in her birinden insanlarla çevriliydi; bomboş suratlarla ellerindeki ekranlara bakıyor, etraflarındaki hiçbir şeyi görmüyorlardı. Kimse önündeki ekrandan kafasını kaldırmıyordu pek. Yürürken insanları seyrediyordum ve gerginliğim gitgide artıyordu. Ara sıra birisi kafasını iPad’inden kaldırınca hafiften umutlanıyor, onunla göz teması kurmaya çalışıyordum, omuz silkip ‘Şuna baksana, bizden başka kimse etrafına bakmıyor, onca yoldan gelip de gözünün önünde duran şeylere bakmıyor,’ demek istiyordum.”

Bütün bunlar bir araya geldiğinde, günümüzde “Sanal Gerçeklik”in (Virtual Reality) “Gerçek Gerçeklik”e (True Reality) üstün geldiği sonucunu çıkarabiliriz sanıyorum. İnsanlık, ellerindeki akıllı aletlerden gördüklerine/gösterilenlere, gerçek hayatta gördüklerinden daha çok değer ve önem veren bir haldedir.

Görüntülerin gerçekliği ise artık risk altındadır.

Bunun, yaşamsal ve felsefi birçok soruyu tetiklemesi kaçınılmazdır. Benim aklıma gelen, şunlardır:

- Demokrasiler bu tehlikelere karşı kendisini nasıl koruyacak?

- İnsan tekleri olarak yurttaşlar, kendilerinin özelliklerinin klonlanmasıyla gerçekleştirilecek sanal saldırılardan nasıl korunacak?

- Sadece ekranda gördüğüne inanmak, “görmese de inanmak” anlamına gelen ve insanın tarihinde ve bugünlere gelişinde önemli yer tutan dünya dinlerini nasıl etkileyecek?

Bu gelişmelerin yaratabileceği sorunlardan, sizin de aklınıza gelenleri yorumlara yazarsanız çok yararlı olacaktır. Bunlar, kendi mesleğiniz, ilgi alanlarınız çerçevesindeki sorunlar olabilir.

Yayınladığım yazıları beğeniyor, onlardan haberdar olmayı ve yazıların size e-posta ile gelmesini istiyorsanız, lütfen aşağıdaki Abone ol düğmesini tıklayarak abone olun. E-posta adresinize gelen onay mesajındaki ilgili kısma tıklamayı da unutmayın. Abonelik işleminiz ancak böyle tamamlanmış olacaktır.

Bir sonraki yazıda görüşebilmek umuduyla.

Yorum bırakın